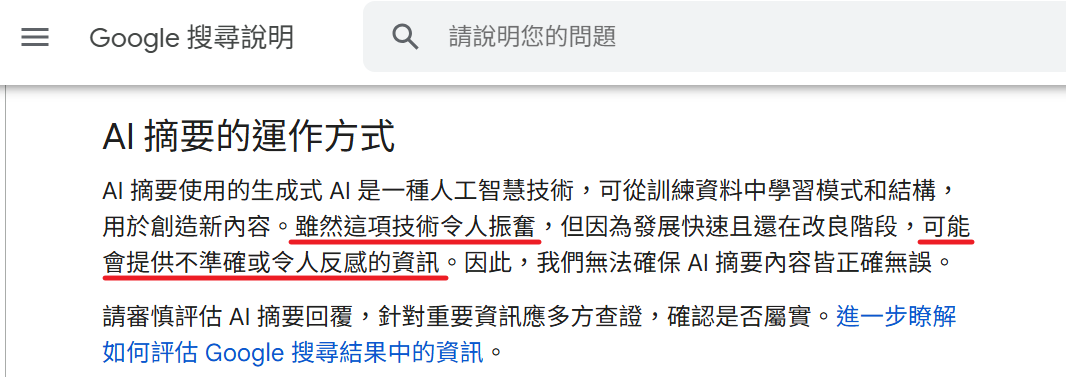

目前 AI 那種「一本正經、胡說八道」的問題,

雖然可以利用 RAG 技術限定回答的範圍來大幅改善,但依然無法完全避免。

因此,幾乎所有公司都會加註提醒與警語。

例如,Google 「AI 摘要」功能中的警語說明 (下圖):

雖然這項技術令人振奮 ... 可能會提供不準確或令人反感的資訊。因此,我們無法確保 AI 摘要內容皆正確無誤。

然而,這樣的不確定性,

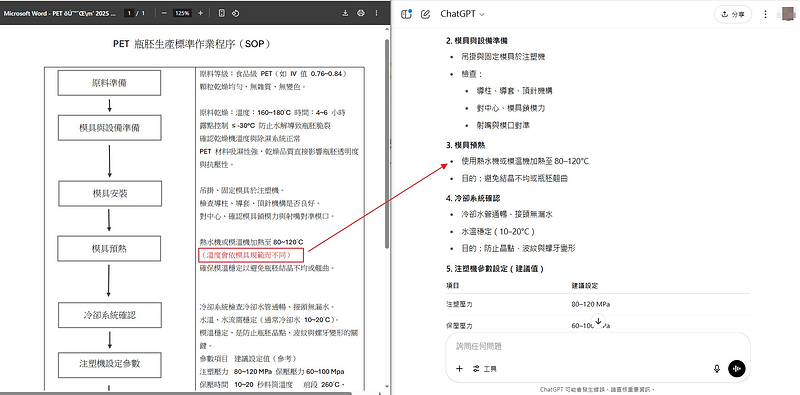

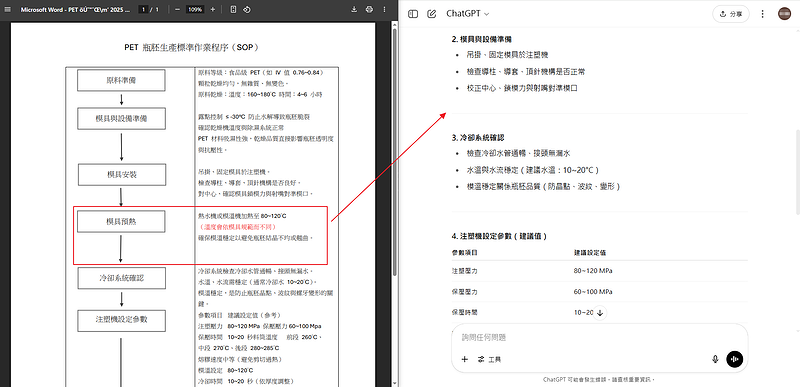

對企業來說,尤其在「標準化的生產流程 (SOP)」,更是一個非常嚴重的問題。

有經驗的員工或許還能察覺異常,

對 AI 的回應保有一定的判斷與思辨能力,覺得「怪怪的」時候,會再進一步查證。

但對新進人員而言,

由於 AI 語氣「一本正經」,反而更容易讓人信以為真、照單全收,進而導致實際的生產錯誤。

也因為 AI 技術本身極具吸引力,全球企業都積極投入,

但與此同時,其「幻覺(hallucination)」問題也開始在實務應用中浮現,

以下就是幾個因 AI 回答不夠精準,所造成嚴重後果的實際案例。

評語

請登入後才可以評分

未登入或權限不足!

- 位置

-

- 資料夾名稱

- 人工智慧之道 ~ 補充

- 上傳者

- 蘇德宙

- 單位

- 台灣數位員工

- 標籤

- 案例, AI 胡說八道

- 建立

- 2025-06-06 06:45:50

- 最近修訂

- 2025-11-24 21:11:42

- 引用

- 1