第一章、人工智慧之道

目前生成式 AI 的主流技術 Transformer 的技術特性,

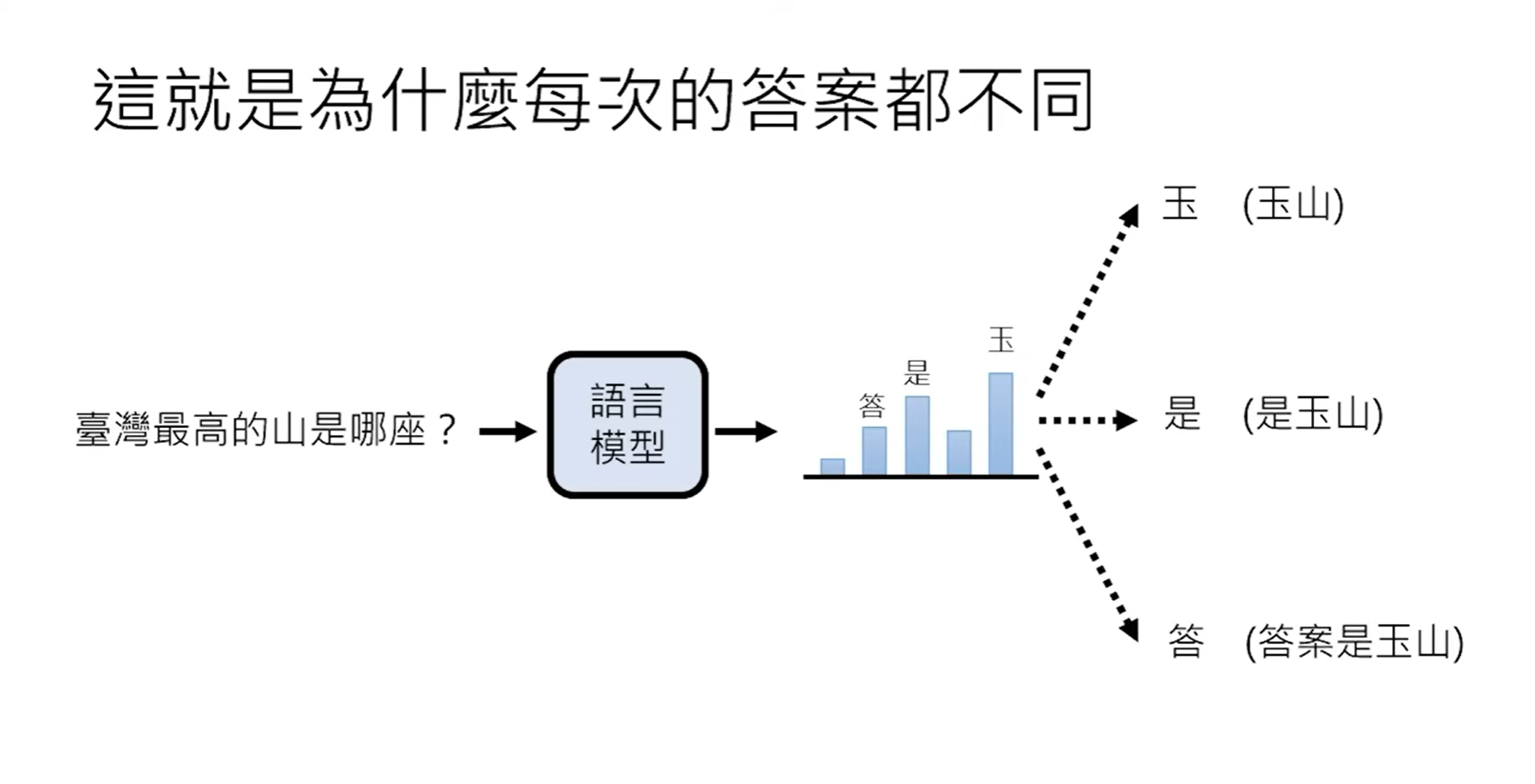

每次問 AI 的回應可能都會不一樣!

更詳細的說明,可以參考台大電機李宏義教授的課程內容 (如下圖)。

AI 幻覺產生的不確定性,

會遺漏重要資訊就不足為其奇了。

例如,

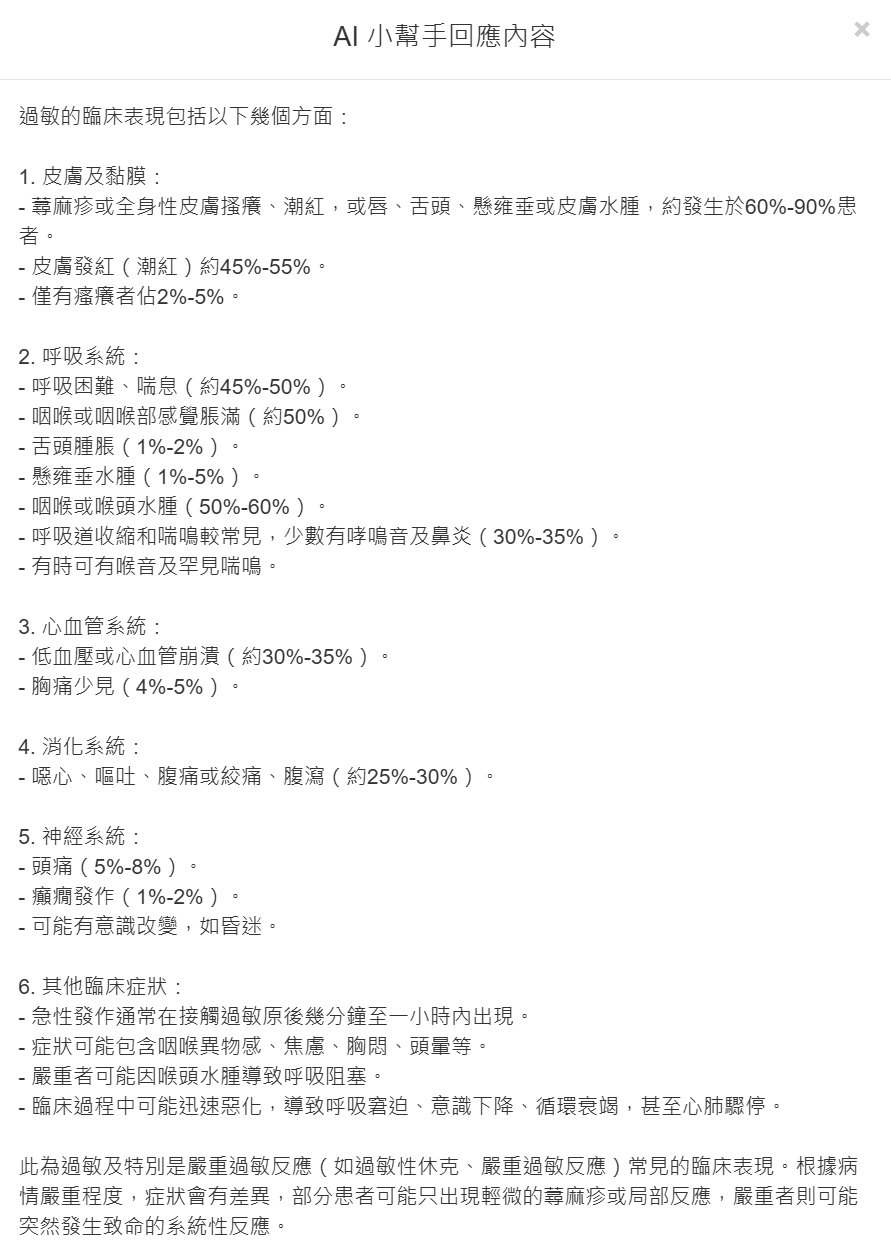

急診醫師判斷病人症狀是否是過敏所引起時,

臨床表現中,各種症狀的「分布比例」是很重要的判斷依據 (圖1)。

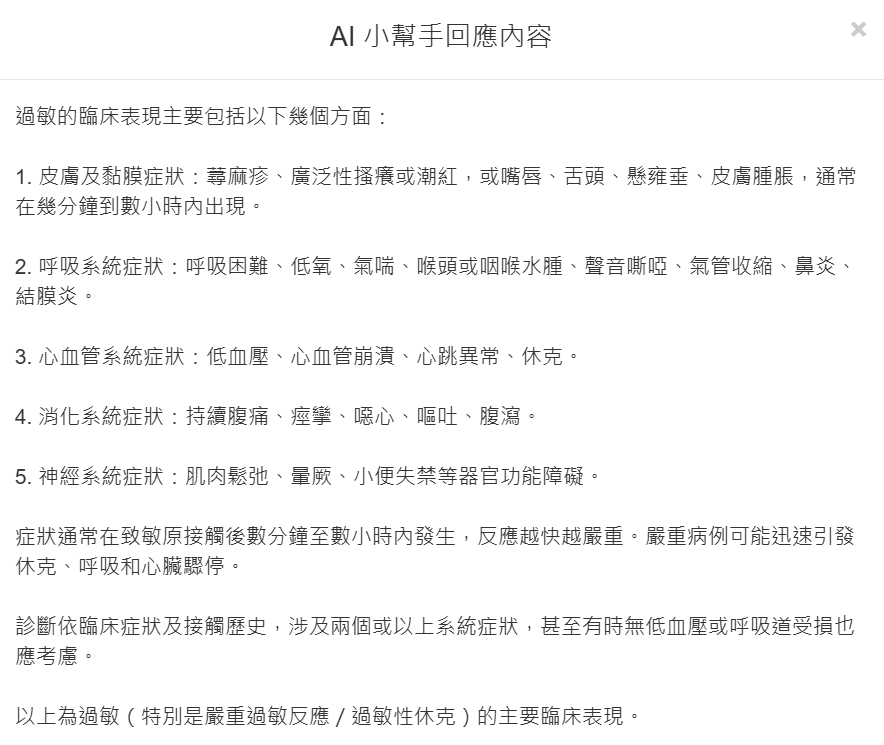

但請 ChatGPT 依據特定教科書內容回應時,

經實驗,大約有 40% 的機率不會列出比例的分布 (圖2) [註]。

雖然 AI 進展非常快速,

但離 AGI 還有一大段距離,這類問題短時間內並不容易解決。

因為這和內容、應用情境有關 (需求),

需要很有經驗的「人類專家」才能判斷。

例如,

過敏的臨床表現,數據分布很重要,

但研究論文的許多實驗細節的數據就不一定這麼重要了,有時候想看的是整理後的趨勢等。

現階段,我們是可以針對特定應用領域訓練 AI 模型,

但這需要大量的成本與人才參與,目前比較難做到,除非願意投入大量的資源,但這又有 CP 值的考量 ...

要如何避免 AI 的不確定性呢? [1]

以現在的技術,最簡單的方式就是

- 不要讓 AI 生成

這樣 AI 就沒機會歪樓了。 - 直接輸出「人類」整理好的經驗 (FAQ)

不經過 AI 生成,就能避免一本正經胡說八道。

可是寫 FAQ 很麻煩耶 ...

這沒辦法,麥當勞的玻璃要乾淨,現階段的技術就只能「每天擦」 ...

其實沒想像中困難喔,

只要每天花10分鐘,抓住幾個關鍵就能搞定![2]

延伸閱讀:

附註:

這是 2025/6 月所做的實驗,使用 ChatGPT 4o 和 4.1 minn 模型。

圖1:有列出分布的比例。

圖2:遺漏重要的「分布比例」資訊。

評語

請登入後才可以評分

未登入或權限不足!

- 位置

-

- 資料夾名稱

- 人工智慧之道 ~ 補充

- 上傳者

- 蘇德宙

- 單位

- 台灣數位員工

- 標籤

- 案例, AI 胡說八道, AI閉嘴, AI技術原理

- 建立

- 2025-06-23 06:44:42

- 最近修訂

- 2025-12-15 13:59:23

- 引用

- 1